Thiết bị đọc não làm dấy lên các tranh cãi đạo đức

Các đại biểu tham dự cuộc họp của Liên Hợp Quốc về đạo đức công nghệ thần kinh vào tháng 5-2025 tại Paris đã xây dựng bộ hướng dẫn toàn cầu đầu tiên nhằm bảo vệ quyền riêng tư của người sử dụng.

Suốt gần 20 năm qua, Ann Johnson không thể đi lại hay nói chuyện sau một cơn đột quỵ khiến bà mất khả năng thăng bằng, thở và nuốt. Nhưng vào năm 2022, Johnson cuối cùng đã có thể nghe lại giọng nói của mình thông qua một hình đại diện (avatar) nhờ một thiết bị cấy não.

Thiết bị này là một ví dụ điển hình cho các công nghệ thần kinh đã bước vào giai đoạn thử nghiệm trên người trong khoảng 5 năm qua. Những công nghệ này — do các nhóm nghiên cứu và các công ty, bao gồm Neuralink của Elon Musk, phát triển — có khả năng điều chỉnh hoạt động của hệ thần kinh để tác động đến các chức năng như nói, cảm nhận và vận động. Tháng trước, những công nghệ này trở thành chủ đề chính trong một cuộc họp ở Paris do UNESCO – cơ quan văn hóa và khoa học của Liên Hợp Quốc – tổ chức, nơi các đại biểu đã hoàn tất bộ nguyên tắc đạo đức điều chỉnh công nghệ thần kinh.

Các khuyến nghị tập trung vào việc bảo vệ người dùng khỏi việc công nghệ bị lạm dụng và vi phạm quyền con người, bao gồm quyền tự chủ và tự do tư tưởng. Các đại biểu, bao gồm các nhà khoa học, chuyên gia đạo đức và chuyên gia pháp lý, đã thống nhất 9 nguyên tắc. Trong đó có những đề xuất yêu cầu các nhà phát triển công nghệ phải công khai cách thu thập và sử dụng dữ liệu thần kinh, cũng như đảm bảo thiết bị an toàn lâu dài đối với trạng thái tinh thần của con người.

“Tài liệu này làm rõ cách bảo vệ quyền con người, đặc biệt là liên quan đến hệ thần kinh,” theo lời Pedro Maldonado, nhà thần kinh học tại Đại học Chile ở Santiago, một trong 24 chuyên gia soạn thảo bộ khuyến nghị này vào năm 2024. Dù chưa mang tính ràng buộc pháp lý, các quốc gia và tổ chức có thể sử dụng những nguyên tắc này để xây dựng chính sách riêng. Tháng 11 tới, 194 quốc gia thành viên UNESCO sẽ bỏ phiếu về việc có chính thức thông qua bộ tiêu chuẩn này hay không.

Thiết bị dành cho người tiêu dùng

Cuộc họp đã xem xét nhiều ứng dụng công nghệ thần kinh, bao gồm các thiết bị cấy vào cơ thể và thiết bị không xâm lấn — đang được nghiên cứu trong y học, giải trí và giáo dục.

Các thiết bị cấy não – máy tính đã có khung pháp lý điều chỉnh tại Mỹ và Liên minh châu Âu. Tuy nhiên, các thiết bị tiêu dùng không phục vụ mục đích y tế, chẳng hạn như các thiết bị đeo, lại ít được quản lý hơn. Điều này làm dấy lên lo ngại về đạo đức vì những thiết bị này có khả năng mở rộng quy mô rất nhanh, theo lời Nataliya Kosmyna, nhà công nghệ thần kinh tại Viện Công nghệ Massachusetts (MIT), người góp phần soạn thảo bộ khuyến nghị. “Điều rất quan trọng là phải hiểu rõ hạ tầng và khả năng mở rộng của các thiết bị này,” cô nói.

Mỗi lĩnh vực ứng dụng lại đặt ra những lo ngại riêng. Chẳng hạn, trong môi trường giáo dục, các đại biểu khuyến nghị nên cấm sử dụng công nghệ thần kinh để đánh giá hiệu quả của học sinh hay giáo viên theo những cách có thể làm trầm trọng thêm sự bất bình đẳng.

Một mối lo khác với thiết bị không xâm lấn là những dữ liệu như chuyển động mắt hay tông giọng có thể bị dùng để suy luận ra trạng thái thần kinh, bao gồm trạng thái tâm trí hay hoạt động não bộ của một người. Một ứng dụng tiềm năng mà các đại biểu muốn quản lý chặt chẽ là “tiếp thị thần kinh” (neuromarketing) — nơi quá trình thần kinh của con người bị thao túng để ảnh hưởng đến quyết định mua hàng hoặc quan điểm chính trị. Các chuyên gia lo ngại rằng hoạt động này có thể xảy ra mà không có sự đồng ý thực sự, khi người dùng không hề hay biết — ví dụ như trong lúc đang ngủ.

Các thiết bị thần kinh thương mại hiện đã đặt ra nhiều rủi ro về dữ liệu và bảo mật, đặc biệt là đối với “quyền riêng tư tâm trí”, theo lời Marcello Ienca, nhà đạo đức học tại Đại học Kỹ thuật Munich (Đức) và là chuyên gia tham gia cuộc họp. “Dữ liệu liên quan đến não và tâm trí cần được bảo vệ ở mức độ cao hơn để ngăn chặn việc tiết lộ trái phép thông tin tinh thần,” ông nói.

Sự đồng ý đầy đủ của người dùng

Một cách để bảo vệ quyền riêng tư tinh thần là thông qua sự đồng ý của người dùng. Khuyến nghị của UNESCO nêu rõ rằng sự đồng ý này phải là “từ trước, tự nguyện và đầy đủ thông tin”, và phải cho phép người dùng rút khỏi việc sử dụng công nghệ bất kỳ lúc nào.

Tuy nhiên, sự đồng ý không phải lúc nào cũng bảo đảm, theo lập luận của Vikram Bhargava, chuyên gia đạo đức công nghệ tại Đại học George Washington ở Washington DC – người không tham gia cuộc họp. “Dữ liệu thần kinh không chỉ tiết lộ thông tin về bạn mà còn có thể tiết lộ thông tin về người khác có đặc điểm thần kinh tương tự,” ông nói.

Những người khác thì không đồng tình. “Sự tương đồng trong cách mọi người suy nghĩ phần lớn liên quan đến nơi họ sống và cách họ sống, hơn là cách não bộ vận hành,” Maldonado phản biện.

Dù vậy, “việc có một tiêu chuẩn toàn cầu mà các quốc gia cam kết tuân thủ là điều rất có sức mạnh,” theo lời Nita Farahany, học giả luật và chuyên gia đạo đức tại Đại học Duke, North Carolina.

Tuy nhiên, xu hướng nới lỏng quản lý ở Mỹ trong các lĩnh vực như trí tuệ nhân tạo cho thấy các công cụ pháp lý có thể không phải là giải pháp tối ưu. Thay vào đó, các quốc gia nên khuyến khích các nhà phát triển tích hợp các tính năng bảo vệ người dùng ngay từ khâu thiết kế, Farahany nói.

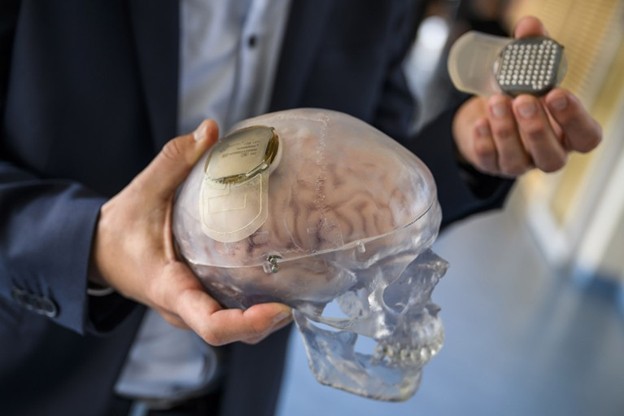

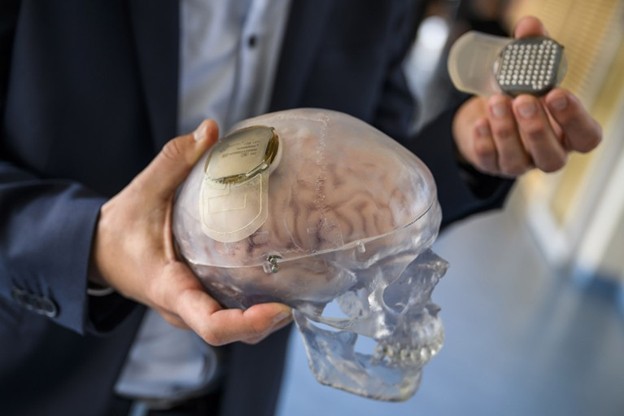

Mô hình hộp sọ người trong suốt được cài đặt thiết bị giao diện não – máy tính. Ảnh: Shutterstock.